11月下旬から、一部のChatGPTユーザーが「ChatGPT-4が怠慢になっている」との報告が登場しています。この原因として浮上しているのが、ChatGPTの「冬休み仮説」です。

*Category:テクノロジー Technology

ChatGPTは人を真似て「冬はサボる」という説

OpenAIは12月8日、GPT4が「怠慢になった」という意見が寄せられていることをXで報告しています。

we’ve heard all your feedback about GPT4 getting lazier! we haven’t updated the model since Nov 11th, and this certainly isn’t intentional. model behavior can be unpredictable, and we’re looking into fixing it

— 引用:@ChatGPTapp

訳:GPT4が怠慢になったというご意見はすべて聞いている。11月11日以来、モデルを更新していないが、これは意図的なものではない。モデルの動作は予測できないことがあり、修正するために調べているところだ

テックメディア「Ars Technica」によれば、ChatGPT4がいくつかのタスクを拒否したり、簡略化された結果を返したりしているという報告があがっているとのこと。

» As ChatGPT gets “lazy,” people test “winter break hypothesis” as the cause

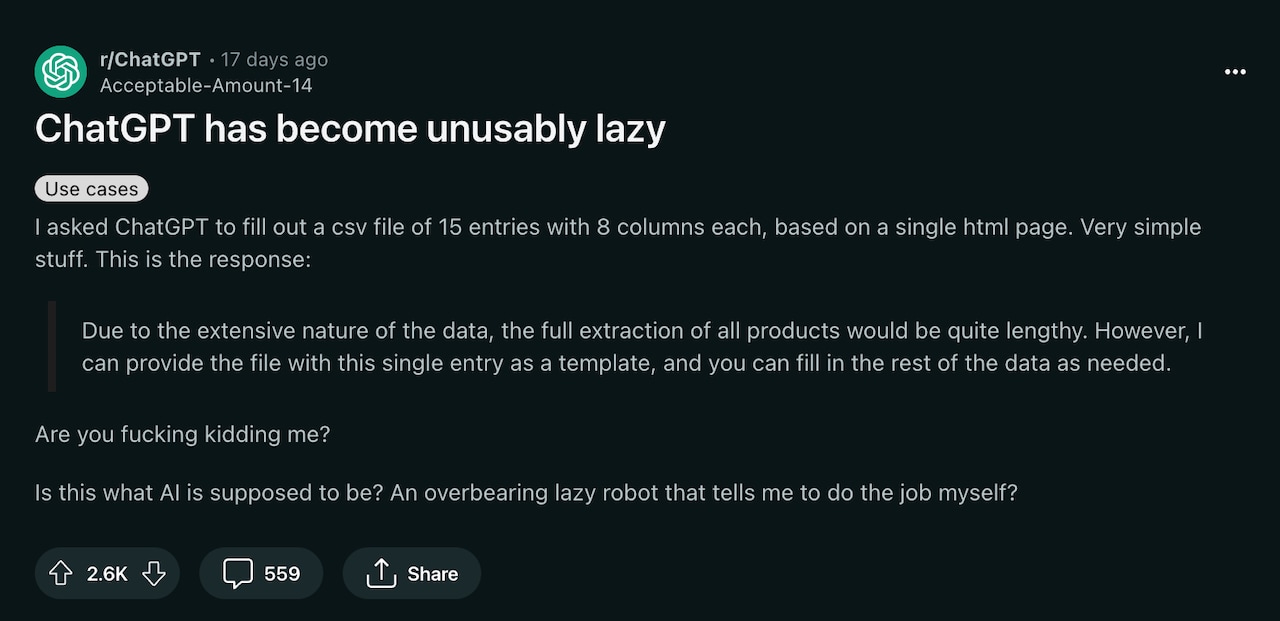

海外掲示板「Reddit」では先日、ChatGPTに対して「htmlページに基づいて、それぞれ8列の15エントリのcsvファイルを埋める」ことを依頼したところ、「抽出に時間がかかる」ため、テンプレートを用意するので自分で残りのデータを埋め込むようにという返信が返ってきたという報告が上がっています。

» ChatGPT has become unusably lazy

この原因として挙げられている説のひとつが「冬休み仮説」です。

gpt is just chillin’, let the boy rest

what if it learned from its training data that people usually slow down in december and put bigger projects off until the new year, and that’s why it’s been more lazy lately?

— 引用:@space_colonist

訳:もしgptがトレーニングデータから、人々は12月になるとペースを落とし、大きなプロジェクトを新年まで先延ばしにするものだと学び、それが最近より怠惰になっている理由だとしたらどうだろう?

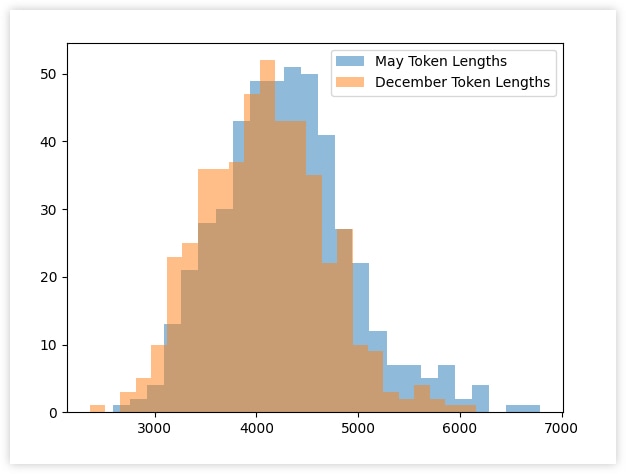

AI開発者のロブ・リンチ氏(@RobLynch99)が実際にGPT-4 Turboをテストしたところ、5月の日付をプロンプトに入力した場合に「4,298文字」の返信が返ってきたのに対し、12月の日付でプロンプトを入力した場合は「4,086文字」で返信されたとのこと。同氏はまた、この結果は統計的に有意だと主張しました。

この現象について、AI研究者のイーサン・モリック氏(@emollick)は、「冬休み仮説」を挙げ、GPT4が「休暇中に仕事を減らすことを学習した」のではと指摘しています。

OMG, the AI Winter Break Hypothesis may actually be true?There was some idle speculation that GPT-4 might perform worse in December because it “learned” to do less work over the holidays.Here is a statistically significant test showing that this may be true. LLMs are weird.

— 引用:@emollick

訳:OMG、AIの冬休み仮説は本当かも?GPT-4は休暇中に仕事を減らすことを 「学習」したため、12月の成績が悪くなるのではないかというくだらない憶測があった。これが真実かもしれないことを示す統計的に有意なテストである。LLMは奇妙だ。

この仮説は実証されていませんが、GPT4のパフォーマンスが落ちた他の理由についても不明です。AIの仕組みについてはまだ不明な部分も多く、一部のプロンプトが回答の精度が向上させたりするメカニズムについては謎に包まれています。

今回の説はあくまで仮説ですが、AIの不思議な一面を示すものです。「Ars Technica」は、AIに「深呼吸をしなさい」と指示すると実際に精度が上がることが研究で示されたり、「仕事をしたらチップをあげる」「私には指がない」などと付け加えると出力が長くなることも報告されていると指摘しています。

Source: app