チャットAI「ChatGPT」などを開発したAI企業OpenAIが、新たな大規模言語モデル「GPT-4」を発表しました。GPT-4は前モデルに比べ、より強力かつ汎用的なAIへと進化しています。

*Category:テクノロジー Technology *Source:The Verge ,OpenAI ,Ars Technica ,Microsoft

人間レベルの性能を実現した新モデル「GPT-4」

OpenAIの大規模言語モデル「GPT」シリーズはChatGPTの核となっているAIです。ChatGPTにはGPT-3.5が採用されており、今回発表されたのはこのモデルの後継です。

GPTシリーズのAIモデルは、主にインターネットから取得した大量のテキストを使用して、一連のトークン(単語の断片)の中で次のトークンを予測するように訓練されています。OpenAIはGPTモデルごとにサイズと複雑さを増やし、モデル間で概ね良好な性能を発揮するようになりました。

前モデルGPT-3との1つ目の違いは、その能力です。GPT-4の能力を分析するために、OpenAIはこのモデルに、統一司法試験、法科大学院入学試験(LSAT)、大学院進学適性試験(GRE)定量、AP科目試験などのテストを受けさせています。その結果、多くのタスクで人間並みのスコアを獲得することに成功しました。

Well this is something else.

GPT-4 passes basically every exam. And doesn't just pass…

The Bar Exam: 90%

LSAT: 88%

GRE Quantitative: 80%, Verbal: 99%

Every AP, the SAT… pic.twitter.com/zQW3k6uM6Z— Ethan Mollick (@emollick) March 14, 2023

GPT-4は「模擬司法試験に、受験者の上位10%程度のスコアで合格している」とのこと。GPT-3.5のスコアは「下位10%程度」でした。テックメディア「Ars Technica」は「GPT-4はAIの新時代の幕開けとなる可能性を秘めている」と指摘しています。

2つ目に、GPT-4はタスク処理性能に関しても、より優れたものになりました。同モデルは最大32,768トークン(約25,000語のテキスト)の生成・処理に対応しており、前モデルよりもはるかに長いコンテンツの作成や文書分析が可能になっています。

Announcing GPT-4, a large multimodal model, with our best-ever results on capabilities and alignment: https://t.co/TwLFssyALF pic.twitter.com/lYWwPjZbSg

— OpenAI (@OpenAI) March 14, 2023

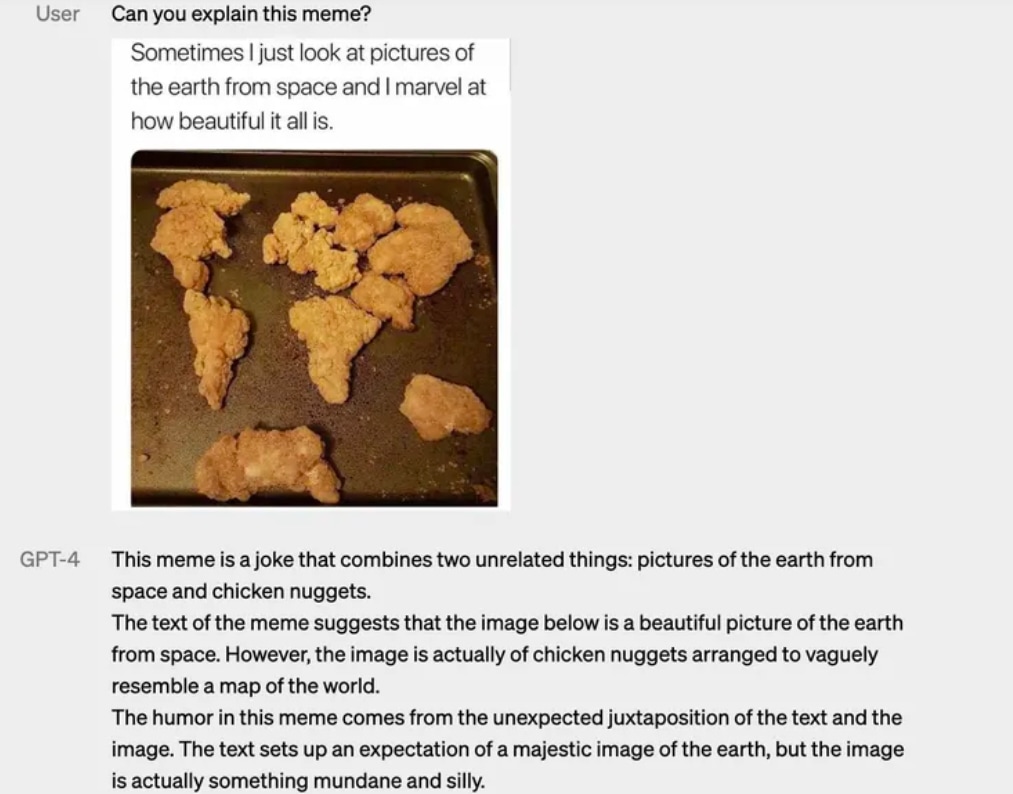

3つ目の違いは、新機能として追加された、画像の内容を解析できるマルチモーダル機能。この機能の追加により、例えば、複数画像からなるジョークを理解したり、図から情報を抽出することができます。ただしこれについては、まだ研究段階のプレビューに過ぎないとのこと。

マイクロソフトとグーグルは、最近、同様のマルチモーダル機能の実験を行っています。特にマイクロソフトは、AI研究者が「人工知能(artificial general intelligence)」と呼ぶ、人間のレベルで一般的なタスクをこなすAIを実現するためには、マルチモーダルなアプローチが必要になると考えています。

また、GPT-4は、GPT-3よりもさらに効果的に人間の言語や会話パターンを再現できると予測されています。人間のフィードバックによる強化学習も、GPT-4がこの目標を達成するための一つの方法です。

ChatGPTの処理と同様にGPT-4は、低評価と高評価のようなボタン機能を通じて、ユーザーからのフィードバックを使ってモデルを学習させます。これにより、GPT-4は誤報や有害なコンテンツが発生しにくくなります。

OpenAIは、GPT-4はまだそこまでは到達していないものの「あらゆる知的作業で、人間を代替できるAGIを開発することが目標である」と述べています。GPT-4の発表の直後、OpenAIのサム・アルトマンCEOは「まだ欠陥があり、まだ制限があり、もっと時間をかけて使った後よりも、最初に使った時の方が印象的に思える」とツイートしました。

here is GPT-4, our most capable and aligned model yet. it is available today in our API (with a waitlist) and in ChatGPT+.https://t.co/2ZFC36xqAJ

it is still flawed, still limited, and it still seems more impressive on first use than it does after you spend more time with it.

— Sam Altman (@sama) March 14, 2023

OpenAIは、GPT-4のテキスト機能をChatGPTとその商用APIを通じて公開する予定ですが、現在はキャンセル待ちの状態です。GPT-4は現在、ChatGPT Plusの加入者に提供されており、GPT-4の画像入力機能は、パートナーである「Be My Eyes(情景を認識して描写するスマートフォン向けアプリ)」でテスト中です。

また、マイクロソフトはGPT-4の発表と同時に、自社のBing Chatにすでにこのモデルが採用されていることを明かしました。同社は公式ブログ記事で「新しいBingが検索用にカスタマイズされたGPT-4上で実行されていることを確認することを嬉しく思います」と述べています。

Source: app